Bu çalışma materyali, Dijital Toplum Teknolojileri 6 dersinin sesli ders kaydı ve ders notlarından (kopyalanmış metin) derlenerek hazırlanmıştır.

Yapay Zekâ Okuryazarlığına Giriş 🧠

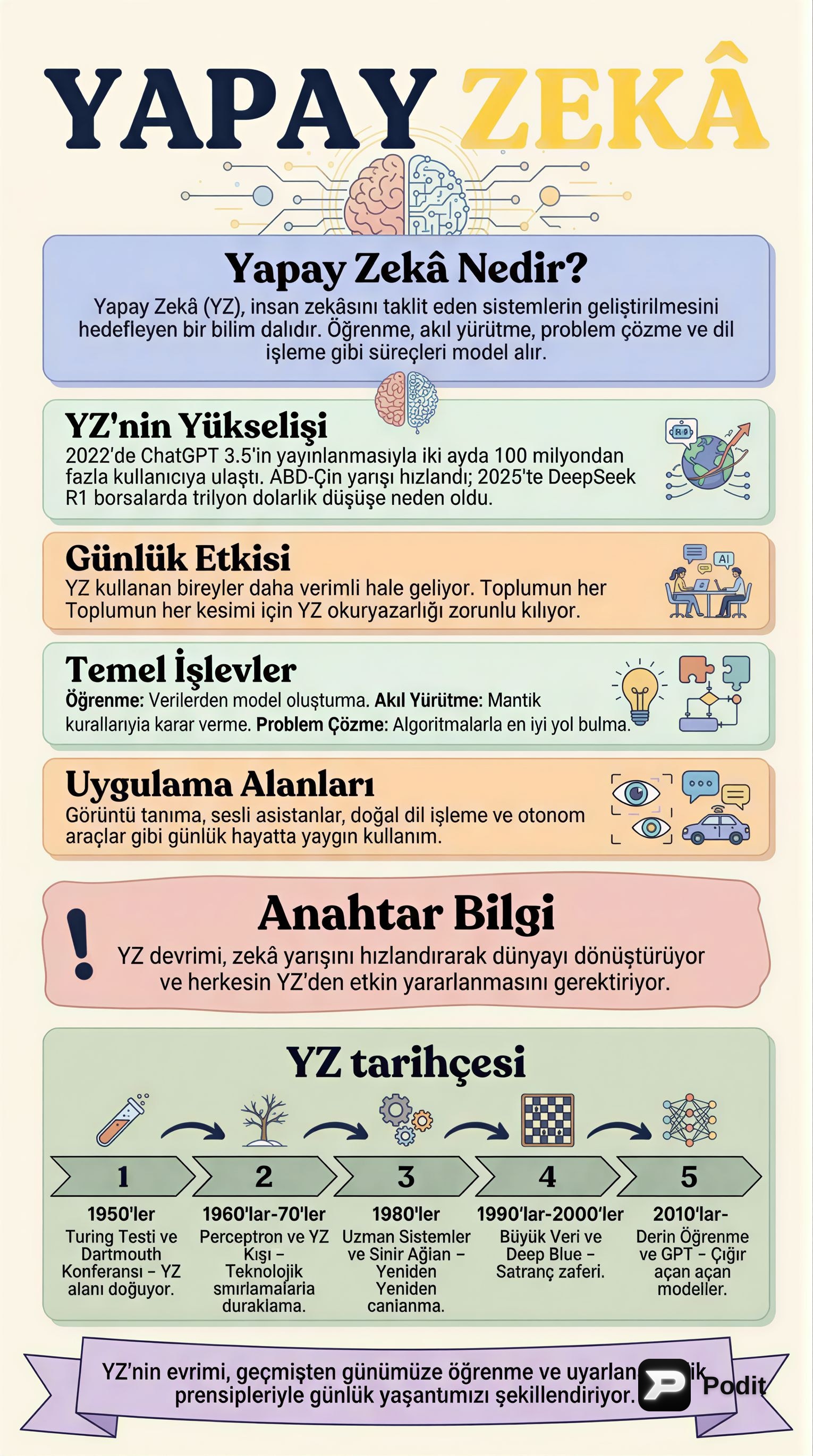

Yapay zekâ (YZ), son yıllarda insan benzeri yanıtlar verebilen sohbet robotlarının ortaya çıkışıyla geniş kitlelerin ilgisini çekmiş, uzmanların ilgi alanından çıkarak toplumun her kesimine yayılmıştır. ChatGPT 3.5'in iki ay içinde yüz milyondan fazla kullanıcıya ulaşması, bu alandaki hızlı gelişimin ve potansiyelin somut bir göstergesidir. Büyük bilişim firmalarının kendi YZ büyük dil modellerini çıkarması ve YZ start-up'larına yapılan rekor yatırımlar, küresel bir YZ yarışını tetiklemiştir. Bu gelişmeler, bireylerin YZ'den etkin bir şekilde yararlanabilmesini zorunlu kılmış ve "yapay zekâ okuryazarlığı" ihtiyacını doğurmuştur.

Bu çalışma materyali, yapay zekânın tarihçesi, temel kavramları, öğrenme türleri ve yaygın uygulama alanları hakkında kapsamlı bilgi sunmayı amaçlamaktadır. Böylece, yapay zekânın geçmişten günümüze nasıl evrimleştiğini, hangi prensiplerle çalıştığını ve günlük yaşantımızda nasıl kullanıldığını anlamanıza yardımcı olacaktır.

1. Yapay Zekânın Tanımı ve Temel İşlevleri 📚

Yapay Zekâ (Artificial Intelligence - AI), insan zekâsını taklit eden veya onunla benzer şekilde çalışan sistemlerin geliştirilmesini hedefleyen bir bilim ve mühendislik alanıdır. YZ, bilgisayarların veya makinelerin insanlar gibi düşünmesini, öğrenmesini, karar vermesini ve problem çözmesini sağlamak için algoritmalar, modeller ve teknikler kullanır.

1.1. İnsan Zekâsının Temel İşlevleri

İnsan zekâsının temel işlevleri, bilişsel yeteneklerimizi ve davranışlarımızı şekillendiren süreçleri içerir. YZ, bu işlevleri model alarak çalışır:

- Öğrenme: Yeni bilgiler edinme, deneyimlerden ders çıkarma.

- Akıl Yürütme ve Problem Çözme: Mantıksal düşünme, analiz etme, karmaşık sorunlara çözüm üretme.

- Bellek: Bilgileri depolama, hatırlama ve gerektiğinde kullanma.

- Dil ve İletişim: Dil kullanarak düşünceleri ifade etme, iletişim kurma.

- Algı: Duyusal bilgileri işleme ve çevreyi anlamlandırma.

- Dikkat ve Odaklanma: Belirli bir göreve veya uyarana odaklanma.

- Yaratıcılık: Yeni fikirler üretme, orijinal çözümler bulma.

- Duygusal Zekâ: Kendi ve başkalarının duygularını anlama, yönetme.

- Planlama ve Organizasyon: Geleceğe yönelik hedefler belirleme, adımlar planlama.

- Soyut Düşünme: Somut olmayan kavramları anlama, teorik fikirler üzerinde çalışma.

- Uyum Sağlama: Yeni durumlara ve değişen koşullara hızla uyum sağlama.

- Karar Verme: Seçenekleri değerlendirme, riskleri analiz etme ve en uygun seçimi yapma.

1.2. Yapay Zekânın Temel İşlevleri

YZ, insan zekâsına öykünerek aşağıdaki temel işlevleri yerine getirir:

- Öğrenme: YZ sistemleri, verilerden öğrenebilir. Makine öğrenmesi algoritmaları, veri setlerini analiz ederek modeller oluşturur ve tahminler yapar.

- Akıl Yürütme: Mantık kurallarına ve algoritmalara dayanarak kararlar verebilir. Tümdengelim (genelden özele) ve tümevarım (özelden genele) çıkarımları kullanır.

- Örnek: Satranç programının milyonlarca hamleyi analiz ederek en iyi stratejiyi belirlemesi.

- Problem Çözme: Belirli problemleri çözmek için algoritmalar ve yöntemler geliştirilmiştir.

- Örnek: Navigasyon uygulamalarının trafik, yol durumu gibi faktörleri analiz ederek en hızlı rotayı belirlemesi.

- Algılama: Çeşitli duyusal verileri (görüntü, ses, sensör verileri) algılayabilir ve analiz edebilir.

- Örnek: Yüz tanıma sistemleri, sesli asistanlar (Siri, Alexa), otonom araçlar.

- Doğal Dil İşleme (NLP): İnsan dilini anlayabilir, işleyebilir ve üretebilir. Dil anlama, dil üretme ve dil çevirisi temel işlevleridir.

- Örnek: E-posta spam filtreleri, sohbet robotları, Google Translate.

2. Yapay Zekânın Tarihçesi ve Gelişimi 📈

YZ'nin kökenleri, elektronik bilgisayarların ilk ortaya çıktığı dönemlere dayanır.

2.1. 1950 Öncesindeki Öncüler

- Alan Turing (1936): Turing Makinesi kavramıyla modern bilgisayarların teorik temelini attı.

- Claude Shannon (1937): Boole Cebiri'ni elektrik devrelerine uygulayarak dijital bilgisayarların temelini oluşturdu.

- John von Neumann: Bilgisayar mimarisi, oyun teorisi ve olasılık teorisi gibi alanlarda YZ'ye zemin hazırladı.

- Norbert Wiener: Sibernetik alanındaki çalışmalarıyla geri besleme mekanizmasını tanımladı, makinelerin öğrenebileceğini gösterdi.

- McCulloch & Pitts (1943): Yapay sinir ağlarının temelini atan sinir hücresi modelini önerdiler.

- Donald Hebb (1949): Sinir ağlarında öğrenme sürecini açıklayan Hebb Kuralı'nı ortaya koydu.

2.2. 1950'ler ve 60'lar: Yapay Zekânın Doğuşu

- Turing Testi (1950): Alan Turing, bir makinenin insan gibi davranıp davranmadığını ölçmek için bu testi geliştirdi.

- Dartmouth Konferansı (1956): John McCarthy tarafından "yapay zekâ" terimi ilk kez kullanıldı ve YZ bağımsız bir araştırma alanı hâline geldi.

- İlk Algoritmalar: Basit oyunları çözebilen programlar (dama, satranç) ve matematiksel teoremleri kanıtlayabilen algoritmalar geliştirildi.

- Perceptron (1958): Frank Rosenblatt tarafından geliştirilen ilk öğrenebilen yapay sinir ağı.

- LISP (1958): John McCarthy tarafından geliştirilen ilk YZ programlama dili.

- ELIZA (1965): Joseph Weizenbaum tarafından geliştirilen ilk doğal dil işleme programı (sohbet robotu).

- Perceptron'un Sınırlamaları (1969): Minsky ve Papert, Perceptron'un doğrusal olarak ayrılamayan problemleri çözemeyeceğini göstererek sinir ağları alanında bir durgunluğa yol açtı.

2.3. 1970'ler ve 80'ler: Yapay Zekâ Kışı ve Yeniden Canlanış

- Yapay Zekâ Kışı (1974-1980): Teknolojik kısıtlamalar ve fon eksikliği nedeniyle YZ araştırmaları duraklama dönemine girdi.

- Yapay Sinir Ağlarının Yeniden Canlanışı (1980'ler): Geri yayılım algoritmasının keşfiyle çok katmanlı sinir ağları eğitilebilir hâle geldi ve örüntü tanımada başarılar elde edildi.

- Uzman Sistemler: Belirli bir uzmanlık alanındaki bilgi ve deneyimi taklit eden sistemler geliştirildi. Ancak 1987'de ucuz kişisel bilgisayarların yaygınlaşmasıyla pazar çöktü ve "İkinci Yapay Zekâ Kışı" yaşandı.

2.4. 1990'lar ve 2000'ler: Yapay Zekânın Yeniden Doğuşu

- Büyük Verinin Artışı: İnternetin yaygınlaşması ve dijital veri miktarının artması, YZ'nin yeniden canlanmasına katkı sağladı.

- Deep Blue (1997): IBM'in Deep Blue bilgisayarı, dünya satranç şampiyonu Garry Kasparov'u yendi.

- Destek Vektör Makineleri (SVM) ve Karar Ağaçları: Makine öğrenmesinde istatistiksel yaklaşımlar gelişti.

2.5. 2010 ve Sonrası: Günümüz Yapay Zekâsı

- Derin Öğrenme: Artan bilgi işlem gücü ve büyük veri ile çok katmanlı yapay sinir ağları (derin öğrenme) yükselişe geçti. Görüntü tanıma, dil işleme ve konuşma tanımada yüksek başarılar elde edildi.

- IBM Watson (2011): Jeopardy bilgi yarışmasını kazanarak toplumun ilgisini çekti.

- AlphaGo (2016): Google'ın AlphaGo'su, Go oyununda dünya şampiyonunu yenerek YZ'nin karmaşık strateji oyunlarındaki üstünlüğünü kanıtladı.

- Transformer (2017): Google tarafından geliştirilen bu algoritma, doğal dil işlemede çığır açtı ve büyük dil modellerinin temelini oluşturdu.

3. Yapay Zekânın Sınıflandırılması ve Öğrenme Türleri ✅

Yapay zekâ sistemleri farklı kategorilere ayrılır ve çeşitli öğrenme yaklaşımları kullanır.

3.1. Gelişim Seviyeleri

- Dar Yapay Zekâ (Narrow AI / Weak AI): Belirli görevleri yerine getirmek için tasarlanmış sistemlerdir. Günümüzde yaygın olarak kullanılan YZ türüdür.

- Örnekler: Yüz tanıma, sesli asistanlar, öneri motorları.

- Sınırlama: Esneklikleri sınırlıdır, farklı alanlara uyum sağlayamazlar (örn. satranç algoritması kedi-köpek ayırt edemez).

- Genel Yapay Zekâ (General AI / Strong AI): İnsanların bilişsel yeteneklerine benzer bir kapasiteye sahip olmayı hedefler. Henüz tam anlamıyla geliştirilmemiştir.

- Süper Yapay Zekâ (Super AI): İnsan zekâsını aşan, teorik bir kavramdır. İnsan beyninden çok daha hızlı düşünebilen, karmaşık problemlere çözüm bulabilen ve yaratıcı kararlar alabilen bir sistemdir. Etik ve güvenlik açısından önemli tartışmaları beraberinde getirir.

3.2. Makine Öğrenmesi ve Öğrenme Türleri

Makine öğrenmesi, YZ'nin bir alt alanı olup makinelerin veri üzerinden öğrenme kabiliyetidir.

- Denetimli (Gözetimli) Öğrenme: Etiketli verilerle eğitilen model, girdilere karşılık gelen doğru çıktıları öğrenir.

- Örnek: El yazısı rakam tanıma, görüntü tanıma, e-posta filtreleme.

- Zorluk: Büyük miktarda etiketli veri gereklidir, bu da maliyetli ve zaman alıcı olabilir.

- Denetimsiz (Gözetimsiz) Öğrenme: Etiketlenmemiş veriler üzerinde eğitilen model, verideki örüntüleri, benzerlikleri veya ilişkileri kendi başına keşfeder.

- Örnek: Müşteri segmentasyonu (satın alma alışkanlıklarına göre gruplama).

- Zorluk: Çıktının yorumlanması bazen zor olabilir.

- Yarı Denetimli (Yarı Gözetimli) Öğrenme: Küçük miktarda etiketli veri ve büyük miktarda etiketsiz veri birlikte kullanılır. Etiketleme maliyetinin yüksek olduğu durumlarda tercih edilir.

- Örnek: Büyük dil modellerinin etiketsiz metin verisi üzerinde eğitilip, denetimli öğrenme ile ince ayar yapılması.

- Pekiştirmeli Öğrenme: YZ'nin çevresiyle etkileşime girerek ödül ve ceza mekanizmalarıyla öğrenmesini sağlar.

- Örnek: Oyun oynama (AlphaGo), robotik sistemler, otonom araçlar.

- Zorluk: Doğru ödül sistemini tasarlamak ve öğrenme sürecini dengelemek zor olabilir.

3.3. YZ Sistemlerinin Temel Bileşenleri

Bir YZ sistemi dört temel bileşenden oluşur:

- Veri: YZ'nin öğrenmesi ve tahminler yapması için temel kaynaktır. Kalitesi ve miktarı YZ'nin başarısını doğrudan etkiler.

- Mimari: YZ modelinin temel tasarım şemasıdır (örn. sinir ağlarındaki katmanların türü, sayısı). CNN, RNN, LSTM, Transformer gibi mimariler bulunur.

- Öğrenme Algoritması: Veriyi işleyerek öğrenme sürecini yöneten matematiksel ve istatistiksel kurallar bütünüdür (örn. geri yayılım, gradyan inişi).

- Model: Algoritmanın işlediği verilerden öğrendiği bilgileri içeren ve yeni girdilere yanıt verebilen eğitilmiş sistemdir.

3.4. Makine Öğrenmesinde Temel Yaklaşımlar

Pedro Domingos'a göre beş ana yaklaşım bulunur:

- Sembolistler: Bilgiyi kurallara ve mantıksal çıkarıma dayandırır (örn. uzman sistemler, karar ağaçları). 1956 Dartmouth Konferansı ile doğmuştur.

- Bağlantıcılar: Biyolojik sinir sistemlerinden ilham alır, sinir ağları aracılığıyla öğrenir (örn. Perceptron, derin öğrenme). Geri yayılım algoritmasıyla yeniden canlanmıştır.

- Evrimciler: Doğal seçilim ve genetik algoritmalar temelinde optimizasyon problemleri çözer.

- Bayesçiler: Olasılık teorisi temelinde Bayes teoremini kullanarak belirsizlikleri yönetir (örn. doğal dil işleme).

- Benzeşimciler: Örnekler arasındaki benzerlikleri kullanarak öğrenir (örn. Destek Vektör Makineleri, k-en yakın komşu).

4. Güncel Gelişmeler ve Büyük Dil Modelleri (LLM) 💡

2010'lu yıllardan itibaren derin öğrenme ve üretken yapay zekâ, YZ alanında önemli atılımlar sağlamıştır.

4.1. Derin Öğrenme

- Tanım: Büyük veri kümeleri üzerinde otomatik olarak öğrenme gerçekleştirebilen çok katmanlı yapay sinir ağlarına dayalı bir yaklaşımdır. "Derin" kelimesi katman sayısının büyüklüğünü ifade eder.

- Başarı Alanları:

- Görüntü İşleme: Evrişimsel Sinir Ağları (CNN) ile (örn. AlexNet'in ImageNet yarışmasını kazanması).

- Doğal Dil İşleme ve Konuşma Tanıma: Yinelemeli Sinir Ağları (RNN), Uzun Kısa Süreli Bellek (LSTM) ve Kapılı Yineleyen Birimler (GRU) algoritmalarıyla.

- Başarı Faktörleri: Büyük veri kümeleri ve GPU'ların (grafik işlem birimleri) hesaplama gücündeki artış.

- Sınırlamalar: Yüksek veri ve hesaplama gücü gereksinimi, "kara kutu" yapısı (açıklanamazlık), aşırı uyum (overfitting) riski.

4.2. Üretken Yapay Zekâ (Generative AI)

- Tanım: Mevcut verilerden öğrenerek yeni ve özgün içerikler üretebilen YZ türüdür (metin, görüntü, ses, video vb.).

- Yaygın Modeller:

- Üretici Çekişmeli Ağlar (GAN): Üretici ve ayırt edici ağların rekabetiyle gerçekçi veri üretir.

- Uygulamalar: Görüntü üretme, yüz sentezi, sanatsal eser oluşturma.

- Tartışmalı Uygulama: DeepFake (sahte video ve görseller).

- Yayılma (Diffusion) Modelleri: Rastgele gürültüden gerçekçi görseller ve sesler elde etmeye odaklanır. GAN'lardan daha iyi sonuçlar üretebilir.

- Uygulamalar: DALL·E 2, Stable Diffusion, Imagen (metinden görüntü), WaveGrad (ses sentezi), Veo 3, Sora (metinden video).

- Dönüştürücü (Transformer) Mimarisi: 2017'de Google tarafından geliştirildi. Dikkat mekanizması (attention mechanism) kullanarak uzun vadeli bağımlılıkları öğrenir. Büyük dil modellerinin temelini oluşturur.

- Üretici Çekişmeli Ağlar (GAN): Üretici ve ayırt edici ağların rekabetiyle gerçekçi veri üretir.

4.3. Büyük Dil Modelleri (LLM)

- Tanım: Doğal dil işleme alanında devrim yaratan, geniş veri kümeleri üzerinde eğitilerek dil anlama, üretme ve dönüştürme süreçlerinde üstün performans gösteren YZ modelleridir. Transformer mimarisi kullanılarak eğitilmiş milyarlarca düğüm içerebilir.

- Temel Yetenek: Diğer sözcükler bağlamında bir sonraki en olası sözcüğü tahmin etmektir.

- Örnekler: OpenAI'ın GPT serisi (ChatGPT), Google'ın Gemini, Meta'nın Llama, Anthropic'in Claude, xAI'ın Grok, DeepSeek, Alibaba'nın Qwen.

- Gelişmiş Özellikler: "Düşünce zinciri" (akıl yürütme sürecini paylaşma), "Derin Araştırma" (otonom internet gezintisiyle rapor oluşturma).

- Çoklu Modlu ve Omni Modeller:

- Çoklu Modlu AI: Farklı veri türlerinden (metin, görsel, ses, video) öğrenerek karmaşık görevleri yerine getirir (örn. GPT-4).

- Omni Modeller: Herhangi bir türde girdiyi işleyip, herhangi bir türde çıktı üretebilir (örn. GPT-4o, DeepMind Gato). Yapay genel zekâya ulaşmanın bir yolu olarak görülür.

4.4. Büyük Dil Modellerinin Sınırlamaları ⚠️

- Yanlış Bilgi Üretimi (Halüsinasyon): Modelin yanlış veya uydurma bilgiler vermesi.

- Veri Ön Yargıları: Eğitildiği verilerdeki ön yargıların çıktılara yansıması.

- Yüksek Enerji Tüketimi: LLM'lerin çalıştırılması için yüksek işlem gücü ve enerji gereksinimi.

- Etik ve Güvenlik Sorunları: Veri gizliliği, kötüye kullanım riski (sahte haber, kimlik avı).

4.5. Açık Kaynaklı Büyük Dil Modelleri ve Yerel Çalıştırma

- Avantajları: Veri gizliliği, özelleştirme, çevrim dışı kullanım, inovasyonu yayma.

- Örnekler: Meta LLaMA, Stability AI StableLM, DeepSeek.

- Yerel Çalıştırma Araçları: LM Studio, Ollama, AnythingLLM.

- Bilgi Getirme Destekli Üretim (RAG): Dil modellerinin güncel ve özel verilere erişmesini sağlayarak daha doğru yanıtlar üretmesini amaçlar.

- Örnek: Hukuk firmasının LLM'i, RAG ile en son mahkeme kararlarını çekebilir.

- Kuantizasyon: Büyük modellerin daha hafif ve verimli hâle getirilmesi için ağırlıkların daha düşük hassasiyette temsil edilmesi.

5. Everything-to-Everything Dönüşümleri 🔄

Yapay zekâdaki en büyük ilerlemelerden biri, farklı veri türlerini birbirine dönüştürebilme kapasitesidir. Bu, "everything-to-everything" (her şeyi her şeye dönüştürme) kavramıyla ifade edilir.

5.1. Text-to-Everything (Metinden Her Şey Üretmek)

Metin tabanlı girdilerin farklı formatlara veya içerik türlerine dönüştürülmesi:

- Text-to-Text: Metin özetleme, çeviri, yeniden yazma, soru-cevap, duygu analizi.

- Text-to-Image: Metin açıklamasından gerçekçi veya sanatsal görsel oluşturma (örn. DALL-E 3, Stable Diffusion).

- Text-to-Speech: Metni yapay bir sesle seslendirme (örn. Google NotebookLM ile ders kitabını podcast'e dönüştürme).

- Text-to-Video: Metin senaryosundan hareketli görüntüler, animasyonlar veya kısa filmler oluşturma (örn. OpenAI Sora, Google Lumiere).

- Text-to-Code: Metin açıklamasından çalışan bilgisayar kodu üretme (örn. OpenAI Codex, GitHub Copilot).

- Text-to-Emotion: Metinlerden duygusal anlam çıkarıp farklı formatlarda yeniden üretme.

5.2. Image-to-Everything (Görüntüden Her Şey Üretmek)

Görsellerin farklı formatlara dönüştürülmesi:

- Image-to-Image: Bir görüntüyü farklı bir stile veya versiyona dönüştürme (örn. fotoğrafı çizime çevirme).

- Image-to-Text: Görsellerdeki metni algılayıp yazıya dökme (OCR).

- Image-to-Video: Statik görüntülerden hareketli videolar üretme (örn. DeepFake teknolojisinin temeli).

- Image-to-3D: İki boyutlu görüntülerden üç boyutlu modeller elde etme.

5.3. Audio-to-Everything (Sesten Her Şey Üretmek)

Ses verilerinin farklı formatlara dönüştürülmesi:

- Audio-to-Audio: Bir ses kaydını farklı bir ses formatına veya stile dönüştürme.

- Speech-to-Speech: Bir ses kaydını analiz edip farklı bir konuşma sentezleme yöntemiyle yeniden üretme (örn. ses klonlama).

- Audio-to-3D: Ses verisini kullanarak üç boyutlu bir ortam veya model oluşturma.

5.4. Video-to-Everything (Videodan Her Şey Üretmek)

Video içeriklerinden farklı formatlarda veri çıkarma:

- Video-to-Video: Bir videoyu farklı bir versiyona veya stile dönüştürme.

- Video-to-Text: Video içeriğini analiz ederek konuşmaları metne dökme veya olayları özetleme.

5.5. Sınırsız Dönüşümün Geleceği 🚀

YZ'nin bu sınırsız dönüşüm yeteneği, dijitalleştirilebilen her yeni mod için katlanarak çoğalmaktadır. Gelecekte, senaryosu, karakterleri, müziği ve her sahnesiyle uçtan uca bir sinema filmini YZ ile üretmek sıradanlaşabilir. Aşırı gerçekçi bilgisayar oyunları ve sanal gerçeklik ortamları çok daha ucuz hâle gelecektir. Ancak bu gelişmeler, insan yeteneğinde körelme ve etik sorunlar gibi potansiyel riskleri de beraberinde getirmektedir. Bu nedenle, YZ araştırmaları ilerlerken etik kuralların ve güvenlik önlemlerinin de aynı hızda gelişmesi zorunludur.